Título: A Revolução da IA em Vídeos e o Perigo da Desinformação

Resumo: O novo software de vídeo da Google, Veo 3, gera clipes quase indistinguíveis dos reais, levantando preocupações sobre a disseminação de desinformação e suas consequências. Este artigo analisa os riscos associados ao uso dessa tecnologia e a resposta da comunidade e da própria Google.

O Impacto da Nova Ferramenta de Vídeo da Google: Veo 3

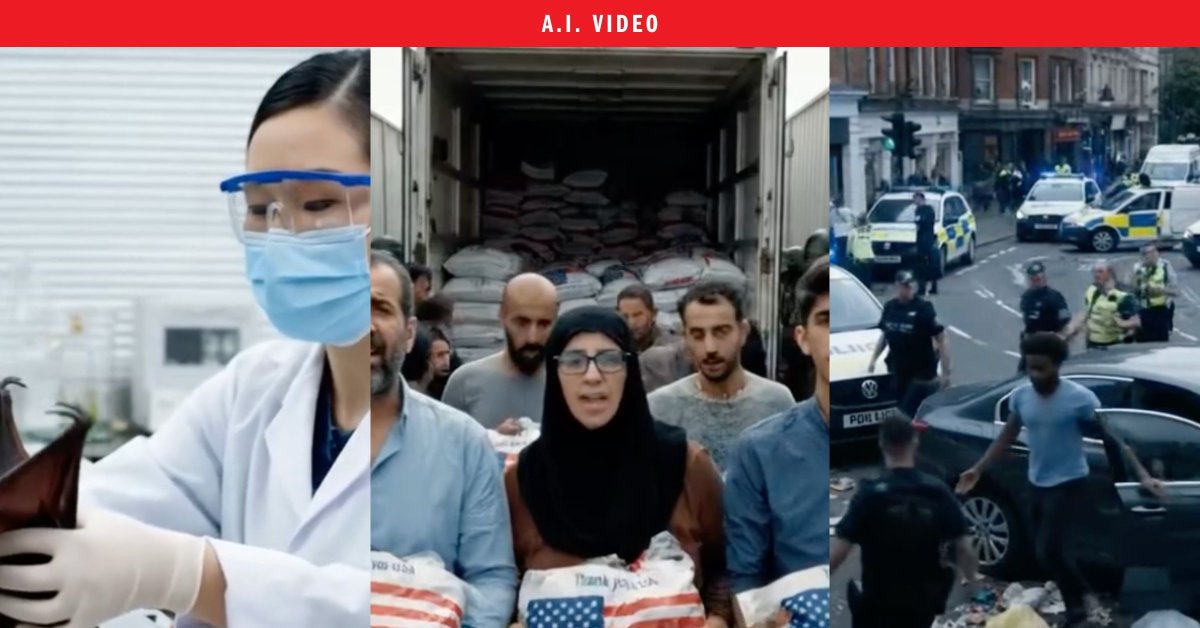

O recém-lançado Veo 3, uma ferramenta de geração de vídeos por IA da Google, representa uma revolução tecnológica ao criar clipes que imitam a realidade de forma alarmante. De acordo com uma análise da TIME, a capacidade deste software de gerar conteúdos visuais convincentes levanta questões sérias sobre a propagação de desinformação e os perigos associados ao seu uso indevido.

Os Riscos Associados ao Veo 3

Os especialistas estão preocupados com a possibilidade de que os vídeos gerados pelo Veo 3 possam ser usados para manipular a opinião pública e incitar conflitos. Entre os clipes gerados estão cenas fictícias de tumultos e comportamentos antiéticos que, embora não precisos, têm o potencial de serem mal interpretados quando compartilhados nas redes sociais. Essa tendência preocupa, especialmente em tempos de crise, onde a verdade e a percepção estão em constante disputa.

Consequentemente, as plataformas de mídia social já estão sobrecarregadas com conteúdos gerados por IA, que até agora principalmente abrange questões políticas. A velocidade à qual esses vídeos são criados e disseminados levanta questões sobre a veracidade das informações consumidas pelo público.

Regulamentações e Bantagens Propostas

A Google, reconhecendo o potencial destrutivo de sua nova ferramenta, anunciou que incluirá uma marca d’água visível nos vídeos criados pelo Veo 3 para ajudar a diferenciar o conteúdo gerado da realidade. No entanto, essa marcação é pequena e facilmente editável. Embora isso represente um esforço da empresa em mitigar os riscos associados à sua tecnologia, muitos especialistas acreditam que isso não é suficiente.

Conhecedores do tema argumentam que medidas mais rigorosas são necessárias para prevenir o uso indevido dessa tecnologia, incluindo regulamentações que impeçam a disseminação de conteúdos comprometedores.

Fatos e Consequências da Desinformação

Com o crescente uso de tecnologias como o Veo 3, a confiança pública nas informações que consumimos online está se erodindo. Especialistas em segurança cibernética alertam que o uso de vídeos gerados por IA poderá ampliar as capacidades de fraudes e desinformação, criando um ambiente onde torna-se cada vez mais desafiador discernir o que é real e o que é fabricado.

Conclusão

À medida que continuamos a explorar os limites da IA, torna-se essencial que tanto desenvolvedores quanto usuários estejam cientes das consequências de suas ações. A responsabilidade não deve ser apenas dos criadores de ferramentas como Veo 3, mas também dos consumidores de conteúdo digital que devem se educar para se proteger contra a desinformação.

Curiosidades sobre o Veo 3 e suas Implicações

- O Veo 3 pode gerar vídeos de até oito segundos, limitando sua produção de conteúdo, mas a expectativa é que isso mude rapidamente.

- Uma das cenas geradas ficticiamente incluiu uma situação de fraude eleitoral, apenas um dos riscos associados à ferramenta.

- A ferramenta é acessível a assinantes premium da Google, custando US$ 249 por mês.

- Apesar de ser projetada para bloquear conteúdo violento, muitos relatos indicam que o Veo 3 assegura resultados controversos.

- A discussão em torno do Veo 3 tem gerado um clamor por regulamentações mais rigorosas em relação às tecnologias de IA, prontamente visando um uso ético e seguro.

Esse artigo não apenas esclarece os potenciais perigos, mas também convida à reflexão sobre a responsabilidade futura no uso dessas tecnologias emergentes. É crucial que continuemos a discutir sobre a ética da IA enquanto esta avança a passos largos.